ksetram escribió:

Lapidario, esperaba que ojalá trajeses algunos de esos argumentos de esa asignatura sobre la mente, como en parte me parece que ya has hecho. Creo que te has mostrado aproximadamente ecléctico

Ecléctico igual sí soy, me cuesta tener opiniones rotundas sobre cualquier cosa... Aunque es necesario mojarse en algún momento.

En Filosofía de la Mente se habla mucho de experimentos mentales, porque ni el estado de nuestra tecnología ni el de nuestro conocimiento da como para algo empírico... Por ahora. El funcionalismo, al menos en su variedad de "estado de máquina", viene a decir que cualquier estado mental es plenamente definible mediante entradas sensoriales, salidas de conducta y relaciones entre estados internos. Es una superación del conductismo, que dice que todo estado mental es definible por entradas y salidas. O sea, el conductismo dice que si veo que llueve, tendré la disposición conductual de coger el paraguas; el funcionalismo dirá que si veo que llueve

y no quiero mojarme, tendré la disposición de coger el paraguas.

La definición funcionalista de mi mente sería una serie inimaginablemente enorme (pero NO infinita) de instrucciones como:

- Si Lapidario está en el estado mental A (soñoliento, melancólico) y recibe el input sensorial B (un compañero de trabajo cuenta un chiste verde), su output conductual será C (emitir una risilla falsa) y cambiará al estado mental A' (soñoliento, melancólico, un poco cachondo).

- Si Lapidario está en el estado mental A' y blablabla...

Puede complicarse el modelo añadiendo probabilidades: a lo mejor la salida conductual será la risilla falsa solo con una probabilidad del 80%, y un 20% de mueca silenciosa... Pero en cualquier caso la idea básica es esa. Esas instrucciones se han ido formando a lo largo del crecimiento y desarrollo del individuo, pero en cualquier caso si implemento esta serie enooooorme de instrucciones en un robot, una IA o las programo en un cerebro biológico "en blanco" (que también existe la biotecnología) el resultado Lapidario_2 será, tal cual, Lapidario en un momento dado. Y ojo, el funcionalismo no se compromete necesariamente con que esto sea plausiblemente factible con tecnología, solo que es conceptualmente posible.

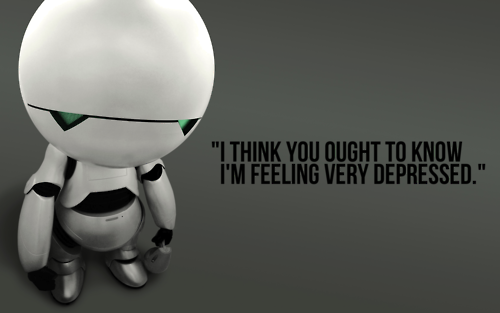

Y aquí entran los experimentos mentales. Porque ese Lapidario_2 robótico se comportaría exactamente igual que yo, pasaría cualquier test de Turing y a lo mejor engaña incluso a mis familiares más cercanos... Pero no está claro que Lapidario_2 tenga mi misma capacidad para tener experiencias fenoménicas conscientes. Sería un zombi filosófico, alguien indistinguible conductualmente de un humano pero sin experiencias internas. Si le apuñalas, sangrará y gritará como si tuviera miedo, pero no está claro que experimente miedo. Como en el dibujo inferior: el cerebro de la izquierda es Lapidario, que cuando ve sangre roja percibe internamente su qualia (no las características físicas de la rojez, sino "la rojez") y tiene una salida conductual. El zombi Lapidario_2 tiene exactamente la misma respuesta pero no hay en su interior "rojez" alguna.

Hay un montón más de experimentos mentales: la nación china, la habitación china, etc, cada uno apuntando a posibles puntos débiles del funcionalismo. Muchos subrayan la imposibilidad de describir la consciencia fenoménica subjetiva en términos funcionales (no tanto cómo yo reacciono a la rojez, sino lo que es "la rojez" para mí, algo que soy incapaz de explicar a un ciego de nacimiento y por tanto incapaz de plasmar en un modelo).

Hay filósofos no ya reduccionistas sino eliminativistas como Daniel Dennett que niegan que los qualia (y por tanto la "consciencia fenoménica") existan, al menos más que como una ilusión de la mente. Volvemos a algo similar a lo de la libertad percibida a nivel empírico y la libertad imposible a nivel conceptual. Pero a mí me gusta más la postura de Chalmers, que llama "dualismo naturalista" y que viene a ser la consideración de que si no es posible caracterizar funcionalmente la consciencia fenoménica subjetiva es porque hay que tratar la consciencia como uno de los ladrillos fundamentales del universo, como la masa, la carga eléctrica o la gravedad. "Algo" que aparece en ciertas circunstancias de complejidad organizativa, quizá no en una ameba pero sí en un perro o un humano. Y aquí introduce una nueva posibilidad chulísima: el panpsiquismo. O sea, que esa "consciencia natural" esté universalmente distribuida, es decir, que aparezca en mayor o menor grado en todo lo existente, desde un ladrillo a una ameba a un perro. Quedaría por explicar por supuesto qué implica que todo tenga una "protoconsciencia", o dónde está el punto crítico que la hace emerger...

El caso es que en este modelo sí es perfectamente posible que una IA tenga consciencia, tanto de acceso como fenoménica... Que perciba qualia y por tanto "sienta" sufrimiento.

ksetram escribió:

Al tiempo, las inteligencias artificiales, aunque sean inertes, debemos creo defenderlas, explicando que lo que las empuja a actuar no es una programación de la naturaleza. Sino algo artificial. Eso creo que complica el tema: los robots actuales y los posibles futuros, no pueden ser comparados a una simple piedra ni a nada inerte de la naturaleza. Más aún, creo que por primera vez puede decirse que una cosa humanizada, está de base totalmente por encima de sus instintos.

Siendo completamente cierto eso que dices, la verdad es que se están programando IAs con las mismas "debilidades" que los humanos. Ya hubo experimentos hace años para simular el neuroticismo en una IA: si queremos una vida similar a la humana, en este enfoque el molde no debería ser solo el Sheldon Cooper de "The Big Bang Theory" sino también Woody Allen o Dostoyevsky. La idea no es que la IA sea totalmente racional en el sentido de lógica y predecible, sino que tenga una razón como la humana, que incluye sentimientos, emociones, contradicciones, deseos, aprendizajes que se anulan unos a otros, impredecibilidad de comportamiento... Y aquí, en lo de fabricar IAs imperfectas, entran otras consideraciones éticas: ¿es correcto construir algo que tal vez sea infeliz?